IHybrid Transformer-CNN-Based Attention in Video Turbulence Mitigation (HATM)

AI 기반 컴퓨터 비전 솔루션 분야의 선두주자인 IK Lab은 권위 있는 ICPR 2024에서 자사의 최신 연구 “Hybrid Transformer-CNN-Based Attention in Video Turbulence Mitigation (HATM)”을 발표하게 된 것을 자랑스럽게 생각합니다. ICPR (International 패턴 인식 컨퍼런스(Conference on Pattern Recognition)는 컴퓨터 비전 연구 분야 최고의 글로벌 행사 중 하나로 인정받고 있습니다.

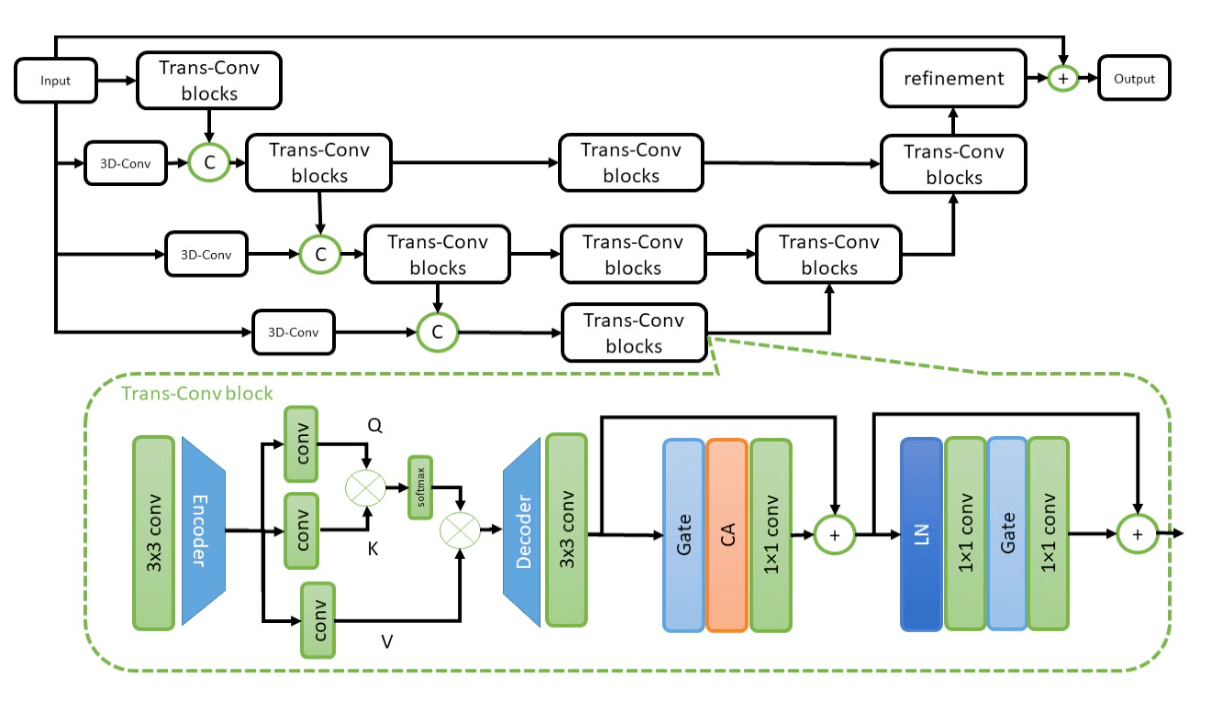

이 연구에서는 비디오 시퀀스의 난류를 완화하기 위해 하이브리드 Transformer와 CNN 기반 주의 메커니즘을 통합한 새로운 딥 러닝 프레임워크를 소개합니다. 효율성을 염두에 두고 설계된 HATM 모델은 고급 주의 메커니즘과 U-Net 아키텍처를 활용하여 이미지 선명도를 크게 향상시킵니다. 합성 및 실제 데이터 세트에 대한 광범위한 테스트는 특히 PSNR 및 SSIM 점수 개선에서 최첨단 방법에 비해 탁월한 성능을 입증했습니다.

수치: 제안된 하이브리드 변압기의 구조 – 컨볼루셔널 난류 완화 게이션 모델(HATM). CA와 LN은 채널 주의와 계층 정규화를 나타내며, 각기.

IK Lab의 설립자이자 수석 연구원인 이익현 박사는 “ICPR에서 우리의 연구 결과를 발표하는 것은 AI 기술의 최첨단을 발전시키려는 IK Lab의 의지를 강조하는 것입니다. HATM의 성공은 최첨단 기술로 실제 문제를 해결하려는 우리의 헌신을 강조합니다. 혁신.”

PDET: 교차 모달리티 가시광선-적외선 사람 재식별을 위한 진보적 다양성 확장 변환기

가시광선-적외선 사람 재식별(VI-ReID)은 약한 조명과 야간 조건에서 인식 성능을 개선하는 데 중요한 역할을 하므로 패턴 인식 및 컴퓨터 비전에서 중요한 연구 방향이 되었습니다. 그러나 기존 방법은 종종 신뢰할 수 있는 특징을 추출하기 위해 모달리티(가시광선과 적외선) 간의 이미지 차이를 최소화하는 데 중점을 두고 유사한 외관을 가진 신원을 구별하는 능력을 무시합니다.

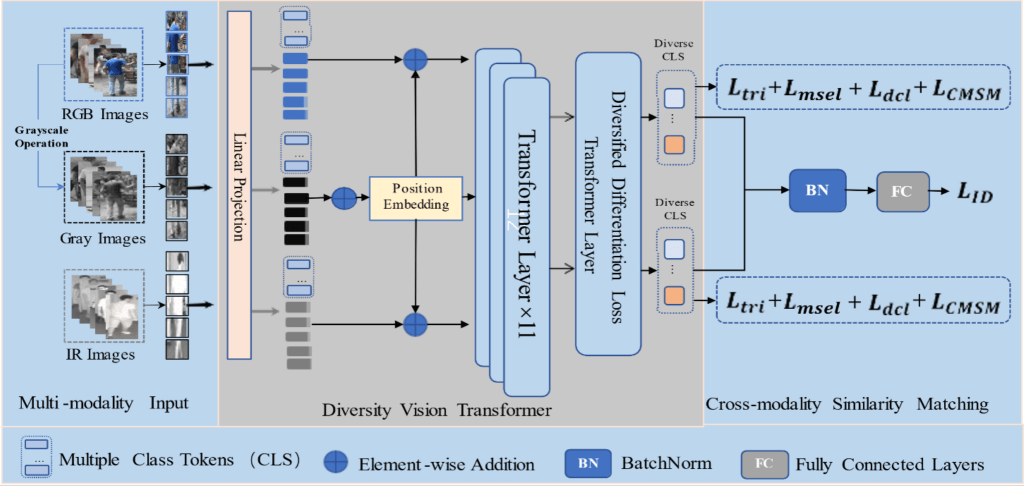

이 문제를 해결하기 위해 우리는 PDET(Progressive Diversity Expansion Transformer)라는 프레임워크를 제안합니다. 여기에는 두 가지 핵심 구성 요소가 포함됩니다.

1. Diversity Distinguishing Vision Transformer Module (DDViTM): 이 모듈은 단일 입력에 대한 여러 임베디드 출력 벡터를 생성하여 모달리티 전반에 걸쳐 보행자의 다양한 특징 표현을 학습합니다. 이는 유사한 외모를 가진 개인을 구별하는 시스템의 능력을 향상시킵니다.

2. Cross-Modality Similarity Matching (CMSM) 모듈: 이 모듈은 가시광선과 적외선 이미지 간의 특징 유사성을 개선합니다. 두 모달리티의 시퀀스 가중치를 동적으로 조정하여 훈련과 네트워크 효율성을 최적화합니다.

우리는 VI-ReID에 대한 널리 알려진 공개 벤치마크인 SYSU-MM01 및 RegDB 데이터 세트를 사용하여 PDET 프레임워크를 평가했습니다. 결과는 우리의 알고리즘이.

수치: 왼쪽 부분은 RGB, Grayscale, IR(적외선) 이미지를 포함하는 멀티모달리티 이미지 입력입니다. 가운데 부분은 이전 부분의 해당 모달리티와 시각적 변환을 위한 다중 클래스 토큰이 있는 Diversity Vision Transformer Module입니다. 손실 함수는 프레임워크 최적화를 위해 오른쪽 부분에 있습니다.

IK Lab은 AI와 머신러닝의 한계를 재정의하기 위해 선도적인 학술 기관 및 업계 파트너와 지속적으로 협력하고 있습니다.

자세한 내용은 공식 사이트를 방문하거나 ihlee@iklab.ai으로 문의하거나 ICPR 2024 장소에서 만나보세요.